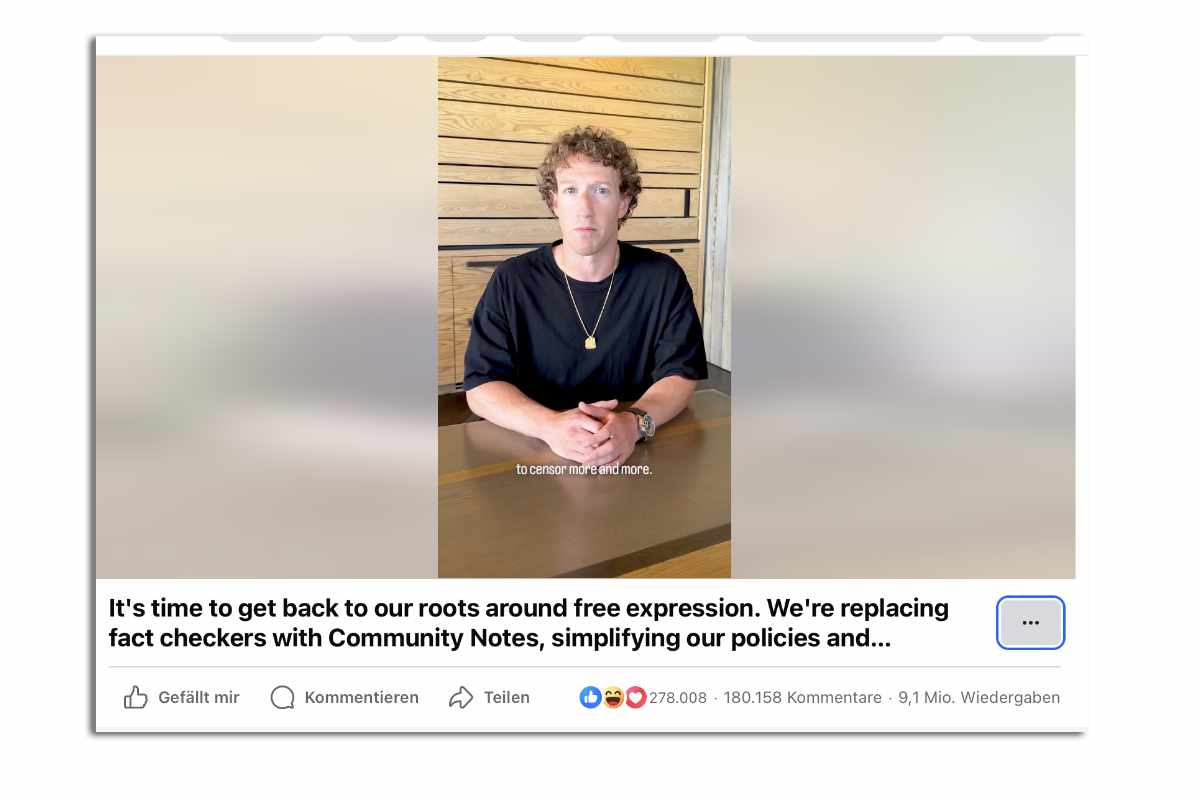

Mark Zuckerberg, der Chef von »Meta«, dem Unternehmen, das hinter facebook, Instagram und WhatsApp steht, hat am Dienstag (7. Januar 2025) weitreichende Änderungen der Moderationsrichtlinien und -praktiken des Unternehmens angekündigt (siehe hier sein Video bei facebook). Als Gründe nannte er ein sich »wandelndes politisches und gesellschaftliches Umfeld« sowie den Wunsch, die freie Meinungsäußerung zu fördern.

Was bedeutet das?

Meta beendet sein Programm zur Faktenüberprüfung mit vertrauenswürdigen Partnern. Stattdessen wird ein gemeinschaftsbasiertes System eingeführt, ähnlich den »Community Notes« bei X (also Twitter). Die »Community Notes« werden also von Nutzern erstellt. Ein Blick in den Maschinenraum dieser Notes zeigt, dass es dort zugeht, wie in jeder anderen Diskussion auf Social Media auch. Die hartnäckigsten Nutzer setzen sich durch. Eigentlich benötigt man »Community Notes« zu »Community Notes«.

Zuckerberg kündigte zudem an, die Moderationsrichtlinien für politische Themen zu überarbeiten. Frühere Änderungen, die den Anteil politischer Inhalte in den Nutzer-Feeds reduzierten, werden rückgängig gemacht.

Die Neuerungen betreffen Facebook und Instagram - zwei der größten Social-Media-Plattformen weltweit mit jeweils Milliarden von Nutzern - sowie den Kurznachrichtendienst Threads.

»Wir kehren zu unseren Wurzeln zurück und konzentrieren uns darauf, Fehler zu reduzieren, unsere Richtlinien zu vereinfachen und die freie Meinungsäußerung auf unseren Plattformen wiederherzustellen«, so »Zuck« in seinem Video.

Der Meta-Meister verwies auf die vergangene US-Präsidentschaftswahl als wichtigen Einflussfaktor für die Entscheidung des Unternehmens. Dabei kritisierte er »Regierungen und traditionelle Medien« für ihren angeblichen Druck, »immer mehr zu zensieren«.

Dummerweise hat Zuckerberg nicht Unrecht. Mohsen Mosleh, Qi Yang, Tauhid Zaman, Gordon Pennycook und David G. Rand haben das für nature untersucht1. Sie haben im Jahr 2020 politische Akteure auf Twitter unter die Lupe genommen und kamen zu dem Schluss, dass Trump-Supporter häufiger sanktioniert wurden durch die Plattform. Warum? Tatsächlich haben diese Accounts häufiger auf Quellen verwiesen, die auf keinen Fall als vertrauenswürdig betrachtet werden können. Weitere Untersuchungen der Autoren mit Daten aus 16 Ländern bestätigen das. Warum bevorzugen Nutzer obskure Quellen mit Falschinformationen? Warum nutzen sie keine anderen Quellen?

Natürlich wird diese Kursänderung von Meta erhebliche Auswirkungen auf die entsprechenden Sozialen Medien haben. Übrigens wird in der öffentlichen Diskussion darüber eines in der ganzen Hektik übersehen: Für Meta dient der Schritt vermutlich gar nicht der »Demokratisierung« oder »weniger Zensur«, sondern der Kosteneinsparung. Community-Manager kosten Geld und zuweilen dauert alles zu lange. Die Auslagerung dieser Arbeit an die Nutzer selbst dürfte eine enorme Kosteneinsparung mit sich bringen. Die Nutzer befüllen also die Netzwerke mit Content und sollen auch selber moderieren.

Das klingt nicht sehr verheißungsvoll, aber der Wegfall der Fakenews-Prüfung ist gar nicht der Kern des Problems. Es gibt 1½ Probleme die eigentlich schwerwiegender sind und der Faktencheck ist nur die Bekämpfung der entsprechenden Symptome.

Erinnern wir uns kurz, was Facebook und Instagram »groß« gemacht hat. Damals in den Zeiten des verheißungsvollen Beginns von Social Media: Die Möglichkeit, mit Freunden in Kontakt zu bleiben. Sein Leben zu teilen, Fotos zu machen (ich im Urlaub, auf der Arbeit, mit der Familie etc.) und einfach sein Ego vergrößern zu können. Ganz nebenbei haben die Menschen begonnen, auch interessante Links zu teilen. Doch dann sind die Dienste zur ersten Anlaufstelle für den Nachrichtenkonsum geworden. Sehr viele Menschen informieren sich heute nur noch über die Sozialen Medien – die jüngeren mehr auf TikTok. Das ist der eigentliche Schmerzpunkt. Es klingt pathetisch, ist aber so: Das muss aufhören. Das ist das erste Problem.

Das andere Problem ist: Die Netzwerke pushen durch ihre Algorithmen den schlechten Content und präsentieren Nutzern, die eigentlich für die Kontakte in den Netzwerken sind, eben jenen Unsinn. Wenn das viele Menschen gut finden, dann muss ja auch etwas dran sein. Das ist bei X so und das ist bei Facebook und Instagram nicht mehr anders. Der »Feed« von Facebook ist heute nicht mehr eine Anzeige dessen, was Freunde chronologisch gepostet haben. Es wird alles Mögliche angezeigt. Besonders gerne bewährter Content mit vielen Reaktionen. Das beinhaltet auch negative. Fakenews-Prüfer haben also vor dem Haus mit dem Laubkehrer gefegt, während um die Ecke Leute mit dem Laubbläser stehen und mehr Laub heranschaffen.

Das Problem liegt also in den Plattformen – nicht bei den Faktenprüfern.

Was wäre also zu tun?

Hochwertige Informationen müssen zugänglich und leicht zu finden sein. Schön, dass die Tagesschau auf TikTok ist, aber sie ist dort den Regeln des Anbieters unterworfen. Das wird nicht funktionieren. Die Europäische Union wird auf eine Regulierung der Inhalte drängen, aber das ändert die innere Mechanik der Dienste nicht. Das wird uns langfristig nicht helfen.

Was können wir tun? Qualitätsmedien verwenden und darauf drängen, dass diese wieder ins Bewusstsein der Menschen rücken. In erster Linie muss jede Person bei sich beginnen und dann auf eine Änderung wirken. Ach ja: Social Media auf gar keinen Fall als erste oder gar einzige Informationsquelle nutzen.

Übrigens: Zum »jüdischen Umgang« mit Social Media kann gerne ein Blick in das Buch »Tzipporim – Judentum und Social Media« geworfen werden (siehe Artikel dazu hier).

Mosleh u. a., „Differences in Misinformation Sharing Can Lead to Politically Asymmetric Sanctions" (Hier online). ↩︎